钱磊、苏武等关于扩散模型似然匹配的研究被ICML接受发表

来源:燕东数据派 2026年5月6日

近日,钱磊、苏武等合作完成的论文《扩散模型的似然匹配》(Likelihood Matching for Diffusion Models)被人工智能与机器学习领域顶会 International Conference on Machine Learning(ICML)接受发表。该论文从最大似然估计视角出发,提出了一种新的扩散模型训练框架Likelihood Matching,为扩散模型的理论分析与生成性能提升提供了新的方法路径。

扩散模型(Diffusion Models)是当前生成式人工智能的重要基础方法,在图像生成、蛋白质设计和数据增强等领域表现突出。现有主流扩散模型通常基于 Score Matching 方法进行训练,即学习不同噪声水平下数据分布的得分函数。然而,从统计学角度看,传统 Score Matching 更多是在优化数据负对数似然的上界,而非直接最大化数据似然本身。如何从最大似然估计原则出发,构造更直接、更高效且具有理论保证的扩散模型训练方法,是生成学习中的重要问题。

本文提出了一种新的扩散模型训练框架:Likelihood Matching(LM,似然匹配)。该方法首先建立了目标数据分布似然与反向扩散样本路径似然之间的等价关系,并在此基础上利用拟最大似然估计思想,对难以直接计算的反向转移密度进行可计算近似。具体而言,文章使用具有匹配条件均值和条件协方差的高斯分布近似每一步反向转移密度,并结合路径时间点的任意性,得到一个可优化的拟似然目标函数。

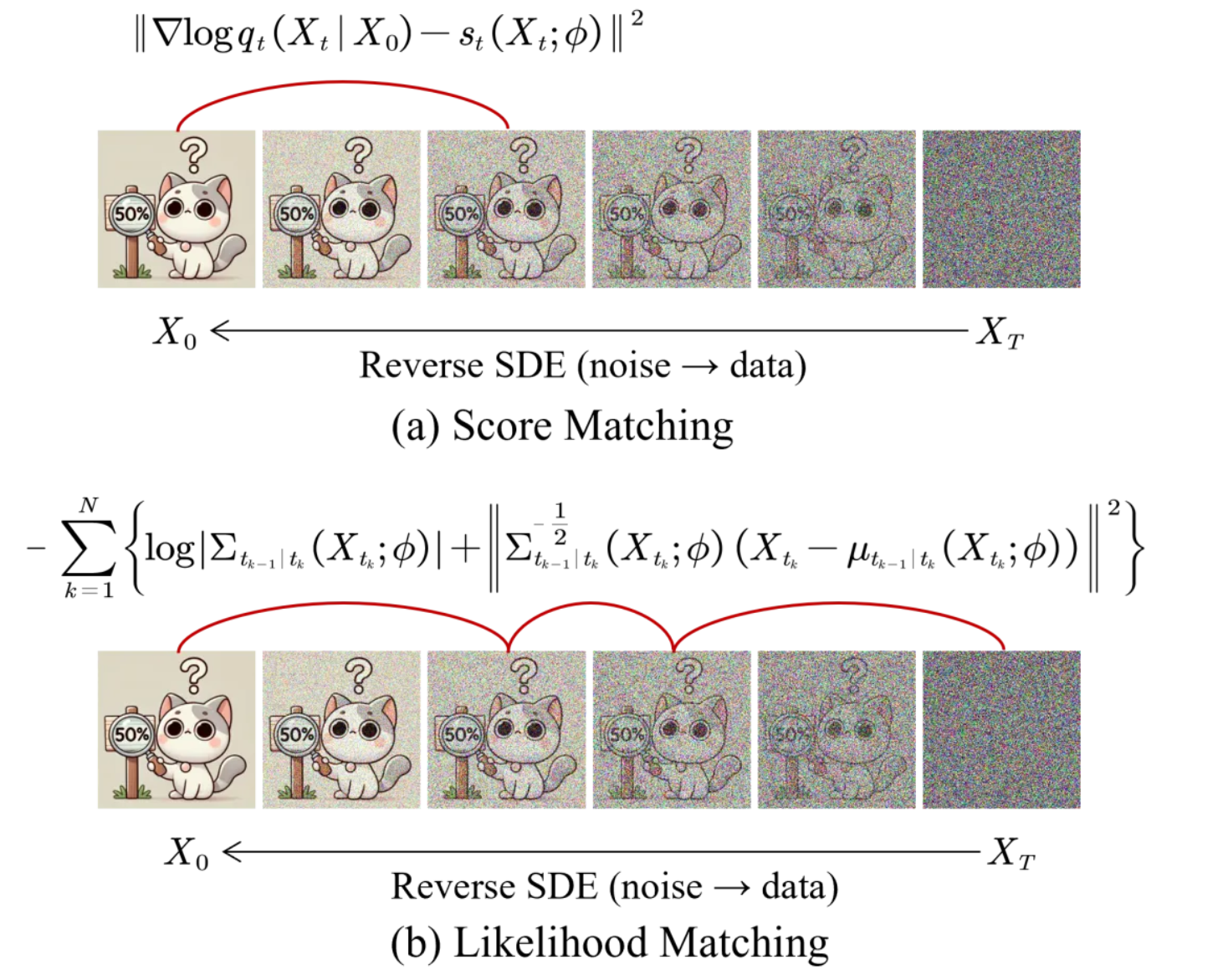

图1 Score Matching (a) 与Likelihood Matching (b) 的示意图

与传统 Score Matching 主要利用一阶矩信息不同,Likelihood Matching 同时结合得分函数和 Hessian 二阶信息,实现了 score matching 与 covariance matching 的统一,并且也完成了likelihood weighting。文章进一步提出了一个基于条件均值和条件协方差结构的随机采样器,使生成过程能够同时利用估计得到的 score 和 Hessian 信息。为降低高维图像数据中的计算成本,文章还采用对角加低秩结构刻画 Hessian,并结合 Sherman-Morrison-Woodbury 公式实现高效计算。

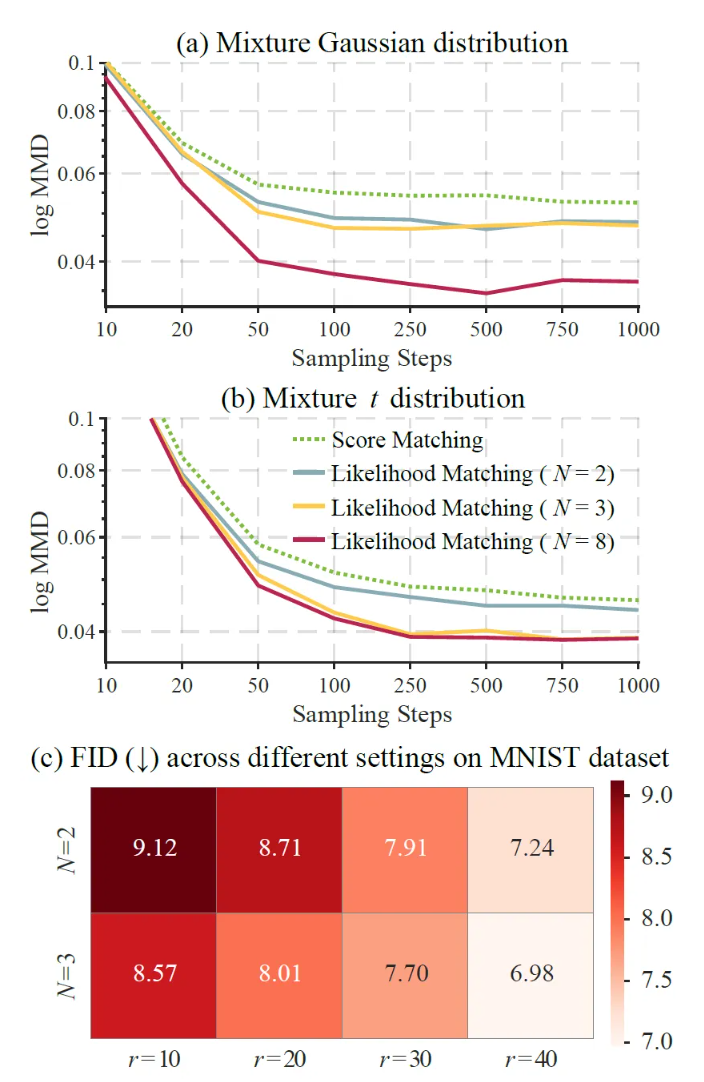

图2 最大均值差异(MMD;越低越好)在两种一维混合分布下生成样本与真实样本之间的比较:(a) 高斯分布和 (b) 自由度为3的t分布,随采样步数N的变化;(c) 在MNIST数据集上,对于似然匹配框架下不同的(N, r)组合,Fréchet Inception距离(FID;越低越好)

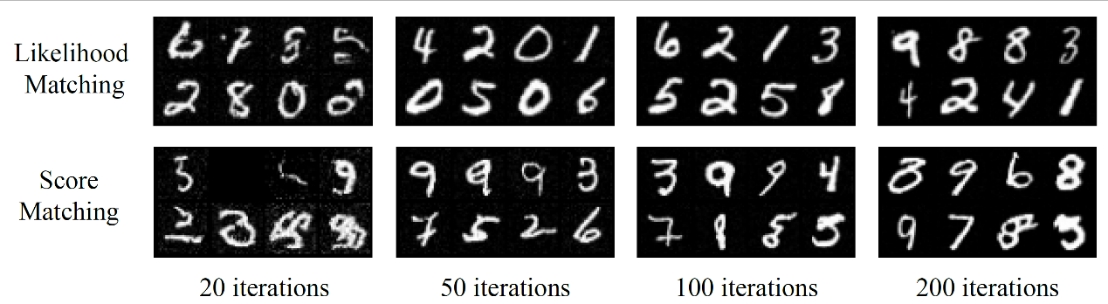

实验结果表明,Likelihood Matching 在多个任务中均优于传统 Score Matching 基线。在混合分布实验中,LM 在 MMD 指标上表现更优,且随着转移步数增加性能进一步提升;在参数估计实验中,LM 相比 Score Matching 获得了更低的平均绝对误差和标准误差。在图像生成任务中,LM 在 MNIST、CIFAR-10 和 CelebA 64×64 数据集上均取得了更好的生成质量和似然表现。MNIST 采样实验也显示,在较少迭代步数下,LM 能更快生成结构清晰的数字图像。

图3 在MNIST数据集上的采样结果对比

文章的第一作者是北京大学大数据科学研究中心2023级硕士生钱磊,陈松蹊教授为通讯作者,也是钱磊的硕士生导师。文章的另一位学生作者为北京大学大数据科学研究中2023级博士生苏武,同样由陈松蹊教授指导。

论文链接:

https://www.songxichen.com/Uploads/Files/Publication/Likelihood_Matching_for_Diffusion_Models.pdf